โพสต์อ้างคลิป “Hezbollah” ในเลบานอน ใช้โดรนโจมตีทหารอิสราเอล ที่แท้คลิป AI

Thai PBS Verify พบแหล่งที่มาของข่าวปลอมจาก: X

โพสต์อ้างเหตุการณ์ “ฮิซบอลลาห์” ใช้โดรนโจมตีทหารอิสราเอลในเลบานอน

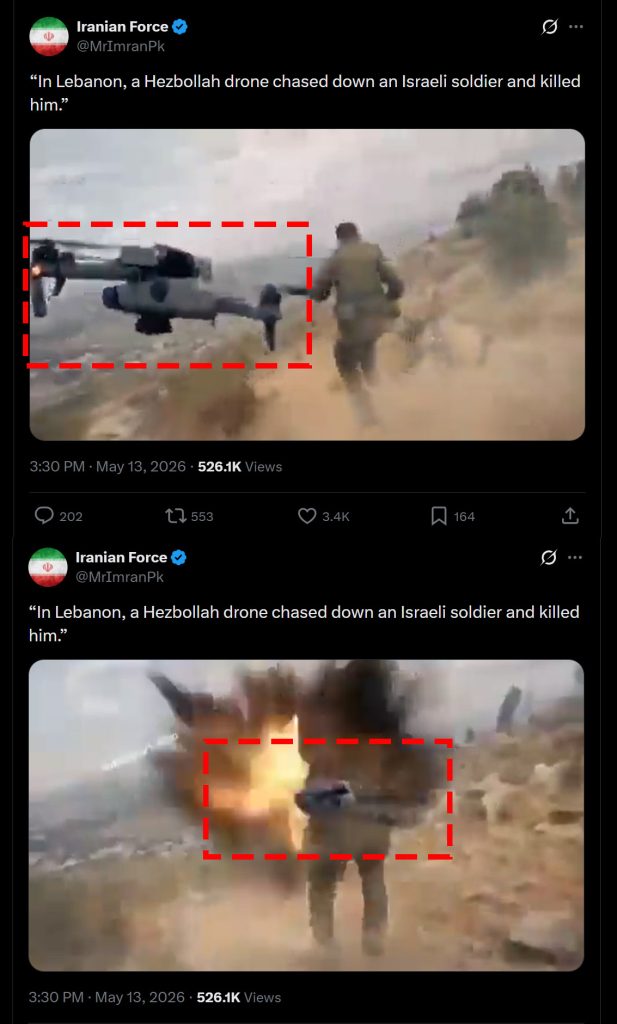

Thai PBS Verify พบโพสต์คลิปวิดีโอพร้อมข้อความบนแพลตฟอร์ม X ที่ถูกเผยแพร่โดยเพจที่ชื่อ Iranian Force โพสต์ดังกล่าวเผยให้เห็นภาพของชายในเครื่องแบบทหารกำลังวิ่งหนีโดรนลำหนึ่ง ก่อนที่โดรนลำนั้นจะพุ่งเข้าชนจนเกิดระเบิดเกิดขึ้น โดยโพสต์ดังกล่าวระบุว่า

“In Lebanon, a Hezbollah drone chased down an Israeli soldier and killed him.”

เมื่อนำมาแปลด้วย Google Translate จะได้ข้อความว่า

“ในเลบานอน โดรนของกลุ่มฮิซบอลลาห์ไล่ล่าและสังหารทหารอิสราเอลนายหนึ่ง”

ทั้งนี้คลิปดังกล่าวถูกเผยแพร่เมื่อวันที่ 13 พฤษภาคม 2569 มีผู้เข้าชมไปกว่า 526,000 ครั้ง รวมถึงมีผู้เข้ามาแสดงความรู้สึกกว่า 200 ครั้ง และแชร์โพสต์ดังกล่าวไปกว่า 500 ครั้ง โดยผู้เข้ามาแสดงความคิดเห็นส่วนหนึ่งเชื่อว่า คลิปดังกล่าวเป็นเหตุการณ์ที่เกิดขึ้นจริง

คลิปโดรนกามิกาเซ่เป็นคลิปจริงหรือไม่ ?

จากการตรวจสอบด้วยการสังเกตพบว่า คลิปดังกล่าวมีจุดสังเกตที่ผิดปกติทั้งในส่วนของโดรนที่ใช้โจมตี ซึ่งแตกต่างจากโดรนที่กลุ่มฮิซบอลลาห์ใช้ โดยจะเห็นว่าโดรนในคลิปไม่มีการติดตั้งระเบิดบนตัวของโดรนแต่อย่างใด แต่เมื่อบินเข้าชน กลับเกิดการระเบิดเกิดขึ้น

ภาพบันทึกหน้าจอแสดงภาพโดรนในคลิปที่พบว่าไม่มีการติดตั้งระเบิดบนตัวของโดรนแต่อย่างใด (บน) แต่เมื่อบินเข้าชนกับทหารในคลิป กลับเกิดการระเบิดเกิดขึ้น (ล่าง)

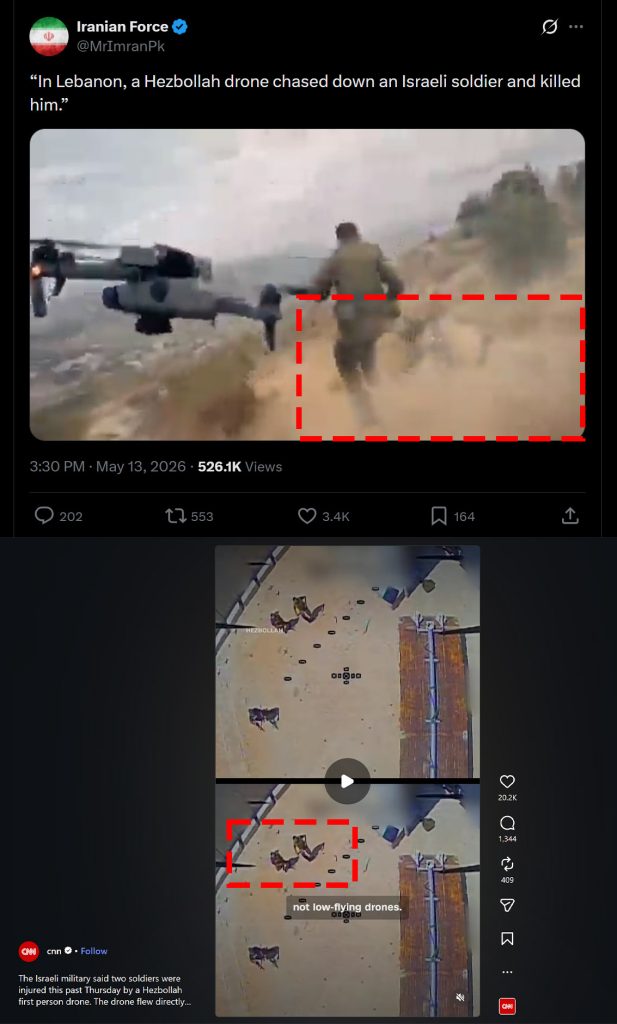

นอกจากนี้เมื่อสังเกตในคลิปจะเห็นว่า ฝุ่นที่เกิดจากการวิ่งหนีของทหารในคลิปพบว่า เกิดฝุ่นมากกว่าปกติที่เกิดจากการวิ่งของคน ซึ่งหากเปรียบเทียบกับคลิปเหตุการณ์ที่ CNN รายงานเหตุการโจมตีด้วยโดรนของกลุ่มฮิซบอลลาห์ต่อทหารอิสราเอลด้วยโดรน จะพบว่า การวิ่งของทหารอิสราเอลจะไม่มีฝุ่นที่เยอะเหมือนในคลิปแต่อย่างใด

ภาพบันทึกหน้าจอแสดงภาพทหารในคลิปขณะวิ่งหนีโดรน พบว่ามีภาพของฝุ่นที่ฟุ้งเกินผิดปกติ (บน) เปรียบเทียบกับ ภาพเหตุการณ์โดรนของกลุ่มฮิซบอลลาห์ขณะกำลังพุ่งเข้าชนทหารอิสราเอล ที่พบว่าไม่มีภาพของฝุ่นที่ฟุ้งจากการวิ่งหนีแต่อย่างใด (ล่าง)

ผู้เชี่ยวชาญชี้ความผิดปกติในคลิปบ่งชี้ว่าคลิปถูกสร้างจาก AI

ผศ. ดร.วีระ สอิ้ง เป็นอาจารย์ประจำภาควิชาวิศวกรรมไฟฟ้าและคอมพิวเตอร์ คณะวิศวกรรมศาสตร์ มหาวิทยาลัยเทคโนโลยีพระจอมเกล้าพระนครเหนือ (KMUTNB) ผู้เชี่ยวชาญด้าน AI ที่ให้ข้อมูลกับ Thai PBS Verify ถึงคลิปดังกล่าวว่า คลิปดังกล่าวมีจุดสังเกตหลายอย่าง ทั้งในเรื่องของใครเป็นผู้ถ่ายคลิปนี้ให้ หรือรายละเอียดของต้นไม้ในคลิปที่อยู่ ๆ ก็เพิ่มขึ้นมาอย่างผิดปกติ

ภาพจากการบันทึกหน้าจอจะเห็นว่า ในช่วงหนึ่งสภาพแวดล้อมไม่มีต้นไม้ในภาพ (กรอบสีแดง)

ภาพบันทึกหน้าจอแสดงความผิดปกติในคลิปที่พบว่า อยู่ ๆ กลับมีต้นไม้ใหญ่ปรากฎขึ้นมาอย่างผิดปกติ (กรอบสีแดง)

ฮิซบอลลาห์โจมตีด้วยโดรนกามิกาเซ่จริงหรือไม่ ?

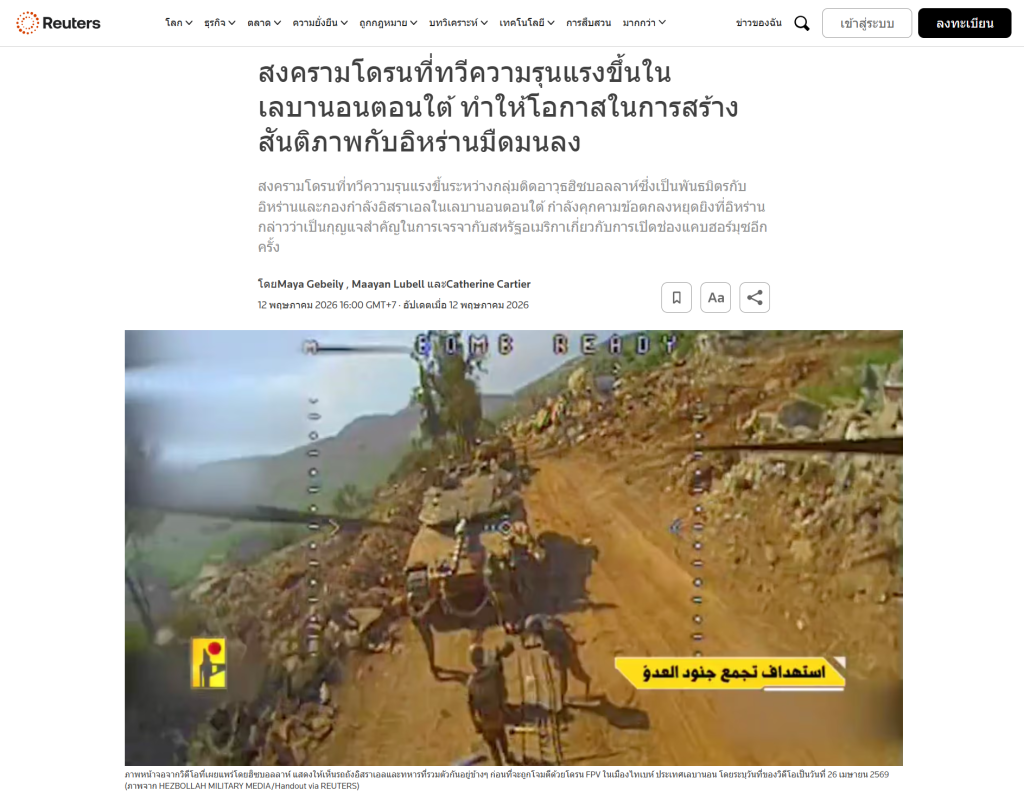

จากการตรวจสอบด้วยคำสำคัญ เราพบข่าวการโจมตีของกลุ่มฮิซบอลลาห์ต่อทหารอิสราเอลจริง โดยในรายงานข่าวจาก รอยเตอร์ ระบุว่า

กลุ่มฮิซบอลลาห์ได้ใช้โดรนพลีชีพแบบมุมมองบุคคลที่หนึ่งราคาถูกและประกอบง่าย เพื่อพลิกโฉมสงครามที่พวกเขากำลังต่อสู้มาตั้งแต่เริ่มยิงใส่อิสราเอลเมื่อวันที่ 2 มีนาคม ซึ่งเป็นเวลาไม่กี่วันหลังจากที่กองกำลังสหรัฐฯ-อิสราเอลเริ่มโจมตีอิหร่าน

โดรน FPV ที่ควบคุมด้วยสายเคเบิลใยแก้วนำแสง สามารถหลบเลี่ยงเทคโนโลยีการรบกวนสัญญาณขั้นสูงของอิสราเอล เพื่อโจมตีทหารอิสราเอลที่ยึดครองเลบานอนตอนใต้ในช่วงหยุดยิงที่ไม่มั่นคงซึ่งประกาศเมื่อวันที่ 16 เมษายน หนึ่งสัปดาห์หลังจากเริ่มการหยุดยิงในสงครามอิหร่าน

รายงานข่าวจากรอยเตอร์ ระบุถึงการใช้โดรนกามิกาเซ่ของกลุ่มฮิซบอลลาห์ต่อทหารอิสราเอล

นอกจากนี้เรายังพบรายงานข่าวจาก AP ที่รายงานข่าวการใช้งานโดรนกามิกาเซ่ โดยรายงานข่าว กลุ่มฮิซบอลลาห์นำอาวุธใหม่มาใช้โดรนใยแก้วนำแสง ซึ่งเคยใช้กันอย่างแพร่หลายในสงครามในยูเครน แสดงให้เห็นถึงสภาพของโดรนกามิกาเซ่ที่มีลักษณะเดียวกันกับโดรนที่ใช้ในสงครามรัฐเซีย-ยูเครน โดยรายงานข่าวดังกล่าวระบุว่า

เทลอาวีฟ ประเทศอิสราเอล (เอพี) — กลุ่มฮิซบอลลาห์ได้เปิดตัวอาวุธใหม่โจมตีทางตอนเหนือของอิสราเอลในการสู้รบรอบล่าสุดนั่นคือโดรนขนาดเล็กที่ควบคุมด้วยสายเคเบิลใยแก้วนำแสงที่มีความกว้างเท่ากับไหมขัดฟัน ซึ่งสามารถหลบเลี่ยงการตรวจจับทางอิเล็กทรอนิกส์ได้

โดรนเหล่านี้ ซึ่งถูกใช้กันอย่างแพร่หลายในสงครามในยูเครนมีขนาดเล็ก ติดตามได้ยาก และเป็นอันตรายถึงชีวิต โดรนเหล่านี้สังหารทหารอิสราเอล 1 นายในเลบานอนตอนใต้ และทำให้ทหารอีกอย่างน้อย 12 นายได้รับบาดเจ็บในอิสราเอลตอนเหนือเมื่อวันพฤหัสบดี โดย 2 นายมีอาการสาหัส ก่อนหน้านี้ในสัปดาห์นี้ ทหารและผู้รับเหมาด้านกลาโหมเสียชีวิตในเลบานอน 1 นาย

ภาพบันทึกหน้าจอแสดงรายงานข่าวจาก AP ที่เผยแพร่ภาพของโดรนใยแก้วนำแสง ซึ่งเคยใช้กันอย่างแพร่หลายในสงครามในยูเครนถูกกลุ่มฮิซบอลลาห์นำมาใช้กับทหารอิสราเอล

เรื่องจริงเป็นอย่างไร ?

จากกรณีคลิปวิดีโอบนแพลตฟอร์ม X โดยเพจ Iranian Force ที่อ้างว่าโดรนของกลุ่มฮิซบอลลาห์ไล่ล่าสังหารทหารอิสราเอลในเลบานอนนั้น เป็นเหตุการณ์ที่เกิดขึ้นจริง แต่ภาพที่ถูกนำมาเผยแพร่เป็นคลิปที่ถูกสร้างขึ้นจาก AI โดยมีข้อสรุปดังนี้

- คลิปดังกล่าวเป็นคลิปที่สร้างจาก AI: ไม่ใช่เหตุการณ์ที่เกิดขึ้นจริง แต่ถูกทำขึ้นเพื่อเรียกยอดการเข้าชม (Engagement)

- การโจมตีจริงมีอยู่จริง: กลุ่มฮิซบอลลาห์มีการใช้โดรนกามิกาเซ่แบบ FPV และโดรนควบคุมด้วยสายเคเบิลใยแก้วนำแสงโจมตีทหารอิสราเอลจริงตามรายงานของ Reuters และ AP แต่ไม่ใช่ภาพตามที่ปรากฏในคลิปไวรัลดังกล่าว

กระบวนการตรวจสอบ

Thai PBS Verify และผู้เชี่ยวชาญด้าน AI ได้ตรวจสอบและพบจุดพิรุธที่พิสูจน์ว่าเป็น AI ดังนี้

-

ฟิสิกส์ของฝุ่น: ในคลิปมีฝุ่นฟุ้งกระจายขณะทหารวิ่งมากผิดปกติ ซึ่งขัดกับภาพเหตุการณ์จริง (เช่น จาก CNN) ที่การวิ่งบนพื้นลักษณะเดียวกันจะไม่เกิดฝุ่นหนาทึบขนาดนั้น

-

ความผิดปกติของวัตถุ (Artifacts): ผศ. ดร.วีระ สอิ้ง ผู้เชี่ยวชาญด้าน AI สังเกตพบว่าสภาพแวดล้อมในคลิปมีการเปลี่ยนแปลงอย่างฉับพลัน เช่น อยู่ ๆ มีต้นไม้ใหญ่ปรากฏขึ้นมาในจุดที่ไม่มีก่อนหน้านี้

-

รายละเอียดของอุปกรณ์: โดรนในคลิปไม่มีการติดตั้งระเบิดให้เห็นชัดเจนแต่เมื่อชนกลับเกิดการระเบิดรุนแรง ซึ่งต่างจากโดรนกามิกาเซ่ที่กลุ่มฮิซบอลลาห์ใช้จริง ที่มีโครงสร้างและการติดตั้งอาวุธที่ชัดเจนกว่า

-

มุมกล้อง: ลักษณะการถ่ายทำเหมือนมีคนถือกล้องวิ่งตามในระยะประชิด ซึ่งในสถานการณ์สงครามจริงที่มีโดรนพลีชีพไล่ล่า เป็นไปได้ยากที่จะมีช่างภาพไปยืนถ่ายในมุมนั้น

ผลกระทบของข้อมูลเท็จนี้

-

สร้างความเข้าใจผิดระดับโลก: คลิปมียอดดูสูงกว่า 5 แสนครั้ง ทำให้คนจำนวนมากเชื่อว่าเป็นสถานการณ์จริง ซึ่งส่งผลต่อความรู้สึกและความคิดเห็นต่อสงคราม

-

ลดทอนความน่าเชื่อถือของข่าวจริง: เมื่อคลิปปลอมแพร่ระบาด สังคมจะเริ่มแยกแยะไม่ออกว่าเหตุการณ์ไหนคือการโจมตีจริง เหตุการณ์ไหนคือภาพสร้าง ส่งผลให้การรายงานข่าวจากสำนักข่าวหลักถูกตั้งคำถามไปด้วย

-

การปั่นกระแส (Propaganda): ข้อมูลเหล่านี้ถูกใช้เป็นเครื่องมือทางการเมืองเพื่อสร้างขวัญกำลังใจปลอม ๆ หรือสร้างความหวาดกลัวเกินจริง

ข้อแนะนำเมื่อได้ข้อมูลเท็จนี้ ?

เมื่อพบเห็นคลิปวิดีโอหรือข้อมูลเกี่ยวกับสงครามที่ดูสมจริงเกินไป ควรปฏิบัติดังนี้

-

สังเกตรายละเอียดเล็กน้อย: มองหาจุดผิดปกติที่ AI มักทำพลาด เช่น สัดส่วนร่างกาย แสงเงา หรือวัตถุที่โผล่ขึ้นมา/หายไปเฉย ๆ

-

เช็กแหล่งที่มา: ตรวจสอบว่าเป็นบัญชีทางการของสำนักข่าวที่น่าเชื่อถือหรือไม่ หรือเป็นเพียงบัญชีทั่วไปที่เน้นโพสต์คอนเทนต์เรียกยอดไลก์

-

ใช้เครื่องมือ Search Engine: นำคำสำคัญหรือภาพจากคลิปไปค้นหาว่ามีรายงานจากสำนักข่าวหลัก (เช่น AP, Reuters, Thai PBS) หรือไม่

-

หยุดแชร์หากไม่แน่ใจ: การแชร์ข้อมูลที่ไม่กรองเท่ากับเป็นการช่วยแพร่กระจาย Fake News และอาจทำให้เกิดความตื่นตระหนกในวงกว้าง