ตรวจสอบแล้ว : “มาลี โสเจียตา” โฆษกกลาโหมกัมพูชา พูดภาษาไทย ตัดพ้อ รพ.ชายแดนไม่รักษาทหารกัมพูชา แท้จริงสร้างจาก AI

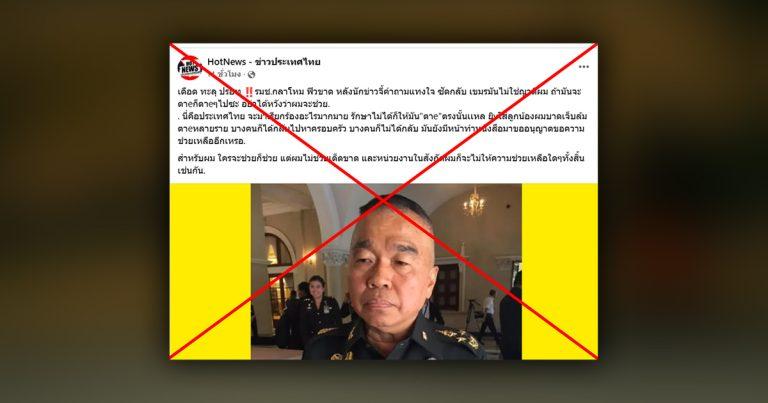

จากการตรวจสอบของ Thai PBS Verify พบว่าข่าวดังกล่าวเป็นข่าวปลอม มีลักษณะบิดเบือนข้อมูลเพื่อสร้างความเข้าใจผิด โดยมีการนำภาพและเสียงของพลโทหญิง มาลี โสเจียตา โฆษกกระทรวงกลาโหมกัมพูชา มาดัดแปลงร่วมกับข้อความ เป็นภาษาไทย เพื่อกล่าวอ้างว่าโฆษกกัมพูชา แสดงความเสียใจต่อกรณีที่ประเทศไทยปฏิเสธให้การรักษาทางการแพทย์แก่ทหารกัมพูชา

Thai PBS Verify พบแหล่งที่มาข่าวปลอมจาก: Facebok

Thai PBS Verify ตรวจสอบพบการนำเทคโนโลยี AI Deepfake และเลียนเสียงมาสร้างคอนเทนต์บิดเบือนอ้าง พลโทหญิง มาลี โสเจียตา โฆษกกลาโหมกัมพูชากล่าวเป็นภาษาไทยว่า เสียใจที่ประเทศไทยไม่ให้ความช่วยเหลือดังกล่าว

บัญชีผู้ใช้แอปพลิเคชัน X การโพสต์คลิปวิดีโอ พลโทหญิง มาลี โสเจียตา โฆษกกลาโหมกัมพูชา ระบุว่า

“อิหยังวะ….สุวรรณมาลี มึงด่าไทยทุกวัน วันนี้มีงอน เสียมไม่มีน้ำใจ ไม่รับทหารกัมพูชาบาดเจ็บมารักษาที่ไทย”

ซึ่งมียอดผู้เช้าชม 1.5 ล้านครั้ง รีโพสต์ 1,000 ครั้ง แสดงความรู้สึก 7,500 ครั้ง และแสดงความคิดเห็นกว่า 1,100 ข้อความ นอกจากนี้ยังมีช่องทางอื่นที่มีการโพสต์คลิปดังกล่าวเช่น ผู้ใช้บัญชี X รายหนึ่ง และช่องยูทูป

ตรวจสอบแล้ว: บิดเบือนจาก Deepfake

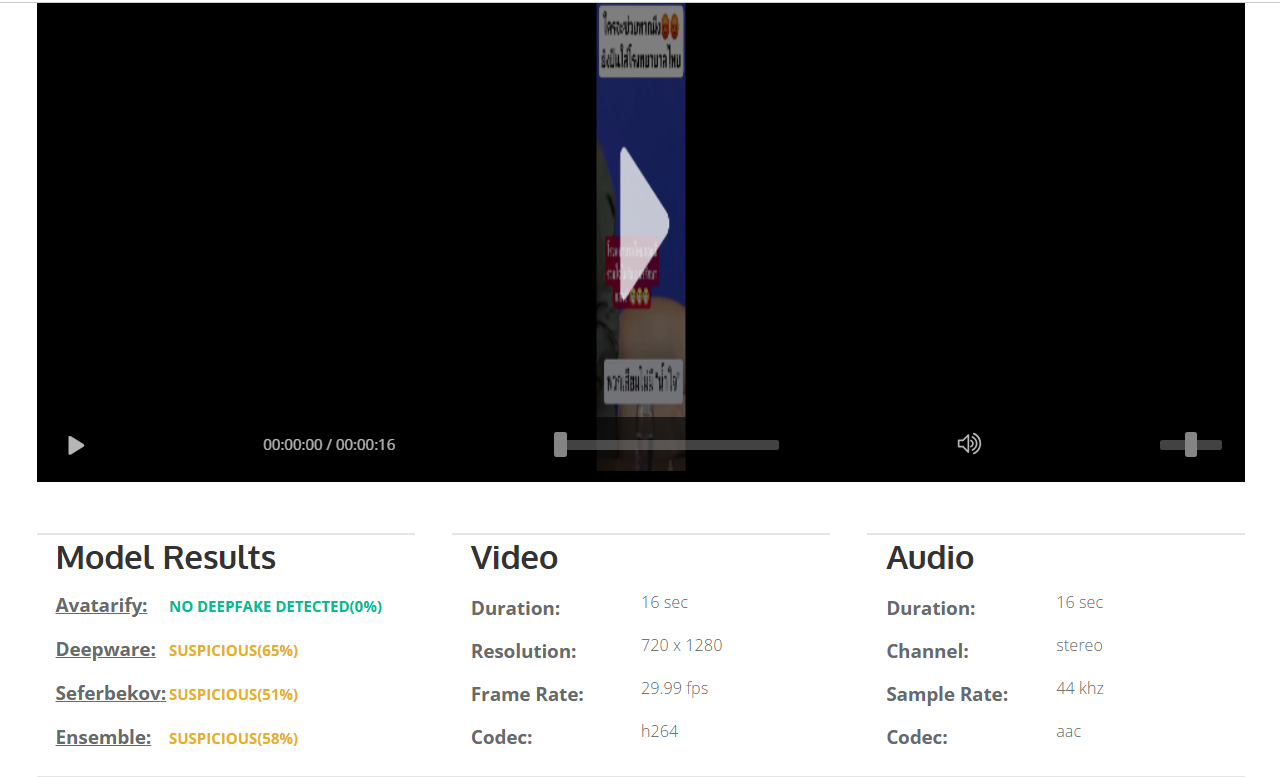

เมื่อทำการตรวจสอบคลิปดังกล่าว ผ่านเครื่องมือตรวจสอบวิดีโอ deepware.ai พบว่าเสียงในคลิปใช้เทคโนโลยี AI ในการบิดเบือนข้อเท็จจริงระหว่างภาพ เสียงและเนื้อหา

ผลการตรวจสอบคลิปวิดีโอดังกล่าวพบว่า เข้าข่ายการใช้โมเดล AI-Deepfake ดังนี้

- เข้าข่ายการใช้โมเดล Deepware ในระดับ 65%

- เข้าข่ายการใช้โมเดล Seferbekov ในระดับ 51%

- เข้าข่ายการใช้โมเดล Ensemble ในระดับ 58%

รมว.ยืนยันไทยให้ความช่วยเหลือด้านการแพทย์ตามหลักสิทธิมนุษยชน

ด้าน สมศักดิ์ เทพสุทิน รมว.สาธารณสุข ชี้แจงกรณีมีข่าวว่าโรงพยาบาลของไทยในพื้นที่จังหวัดชายแดนไทย-กัมพูชา ปฏิเสธการรักษาทหารกัมพูชา ว่า ไม่มีข้อเท็จจริง ยังคงมีการรักษาคนไข้ชาวกัมพูชาอยู่ ไม่มีการไล่ให้ออกจากโรงพยาบาล และดูแลตามหลักสิทธิมนุษยชน

ส่วนกรณีการให้หยุดปฏิบัติหน้าที่คือ กรณีที่ชาวกัมพูชามาทำงานในโรงพยาบาล หรือบุคคลที่ทำหน้าที่ล่ามแปลภาษาไทยกับกัมพูชา ให้หยุดปฏิบัติหน้าที่ชั่วคราว เหตุเพราะมีโดรน มาบินอยู่บริเวณโรงพยาบาล จึงต้องมีการป้องกันและระมัดระวัง และยอมรับว่า ป้องกันเรื่องการเป็นสายลับ และรอผลการเจรจาสองประเทศในวันที่ 4 ส.ค.นี้ ที่ต้องฟังกระทรวงกลาโหมเป็นหลัก

กระบวนการตรวจสอบ

ใช้เครื่องมือตรวจสอบวิดีโอ จากเว็บไซต์ deepware.ai : พบว่าเข้าข่ายการใช้โมเดล Deepfake แปลงภาพเสียงในคลิปบิดเบือนข้อเท็จจริง พบความผิดปกติการเคลื่อนไหวของท่าทาง รูปปากขณะกำลังพูด ที่ไม่เป็นธรรมชาติ

ผลกระทบจากการรับข้อมูลลักษณะนี้

- กระทบความสัมพันธ์ระหว่างประเทศและเพิ่มความรุนแรงของความขัดแย้ง

ข่าวปลอมที่กล่าวอ้างว่าประเทศไทยไม่ช่วยเหลือด้านการแพทย์ต่อทหารกัมพูชา อาจสร้างความเข้าใจผิดในวงกว้าง และบั่นทอนความเชื่อมั่นระหว่างประชาชนสองประเทศ รวมถึงส่งผลต่อความร่วมมือระหว่างรัฐบาลในประเด็นชายแดนหรือมนุษยธรรม - ปลุกปั่นความเกลียดชังและความขัดแย้ง

คลิป Deepfake ที่ทำให้เข้าใจผิดว่าเจ้าหน้าที่ระดับสูงของประเทศเพื่อนบ้านตำหนิไทย อาจกระตุ้นให้เกิดความคิดเห็นเกลียดชัง และความเกลียดชังออนไลน์ ซึ่งนำไปสู่ความขัดแย้งในสังคมและความรุนแรงของสถานการณ์ความขัดแย้งมากขึ้น - บิดเบือนข้อเท็จจริง สร้างความเข้าใจผิดในสาธารณะ

ผู้รับข้อมูลโดยไม่ตรวจสอบอาจเข้าใจผิดในบทบาทของหน่วยงานภาครัฐของไทย รวมถึงสงสัยในจริยธรรมของบุคลากรการแพทย์โดยไม่เป็นธรรม

ข้อแนะนำเมื่อได้ข้อมูลเท็จนี้ ?

- อย่าด่วนแชร์ต่อ

หากยังไม่ได้ตรวจสอบจากแหล่งข้อมูลที่เชื่อถือได้ เช่น หน่วยงานรัฐ อย่าแชร์เพื่อป้องกันการขยายข้อมูลเท็จ - พิจารณาเนื้อหาที่ฟังดูผิดธรรมชาติ

หากคลิปวิดีโอดูไม่เป็นธรรมชาติ เช่น การพูดคล้ายพากย์, ปากไม่ตรงกับเสียง, ภาษาที่ไม่สอดคล้องกับบุคลิก ลองตั้งข้อสงสัยไว้ก่อนว่าอาจเป็น Deepfake - รายงานไปยังแพลตฟอร์มหรือหน่วยงานที่เกี่ยวข้อง

กดรายงานคลิปใน X, Facebook หรือแจ้งหน่วยงานที่ทำหน้าที่ตรวจสอบข่าวปลอม เพื่อให้หยุดการแพร่กระจายข้อมูลเท็จ

- ส่งเสริมการรู้เท่าทันสื่อ

- แบ่งปันความรู้กับคนใกล้ตัว โดยเฉพาะผู้สูงอายุ หรือผู้ที่อาจไม่คุ้นเคยกับเทคโนโลยี ว่า AI สามารถปลอมแปลงเสียงและภาพได้อย่างแนบเนียน และต้องมีการตรวจสอบเสมอ

- สังเกตวิดีโอที่สร้างจาก AI-Deepfake ดังนี้

- สังเกตการขยับริมฝีปาก ไม่ sync กับคำพูด

- สังเกตการเคลื่อนไหวจะไม่ smooth เพราะมีการตัดต่อวิดีโอ

- สังเกตท่าทางเคลื่อนไหวจะซ้ำ ๆ เหมือนวนลูป

- สังเกตการใช้สำเนียงของเสียงบรรยายในคลิป