โพสต์อ้างภาพเครื่องบินรบ F-35 ของอิสราเอลได้รับความเสียหาย แท้จริงสร้างจาก AI

Thai PBS Verify พบแหล่งข่าวปลอมจาก: X

โพสต์อ้างเครื่องบินรบของอิสราเอล F-35 ถูกทำลายบนภาคพื้น

Thai PBS Verify ตรวจสอบพบโพสต์อ้างเครื่องบินรบของอิสราเอล F-35 ถูกทำลายบนภาคพื้น

ระบุว่า

Son dakika | İsrail F-35 filosu Mobagat saldırısında karadayken imha edildi

แปลด้วย Google Translate ได้ใจความว่า

ข่าวล่าสุด | ฝูงบิน F-35 ของอิสราเอลถูกทำลายบนพื้นดินระหว่างการโจมตีโมบากัต

โพสต์ดังกล่าวถูกเผยแพร่เมื่อวันที่ 21 มี.ค. 69 มียอดเข้าชมกว่า 133,683 ครั้ง

ภาพเหตุการณ์ดังกล่าวเป็นภาพจริงหรือไม่ ?

เมื่อค้นหาแหล่งที่มาของภาพด้วยการใช้เครื่องมือตรวจสอบภาพ Google Lens พบว่า ไม่ปรากฏแหล่งที่มาที่ชัดเจน หรือสอดคล้องกับรายงานของสื่อต่างประเทศแต่อย่างใด เกี่ยวกับเหตุการณ์เครื่องบินรบ F-35 ของอิสราเอล และเมื่อค้นหาด้วยคำสำคัญ จะพบรายงานจาก CNN อ้างถึง F-35 ของสหรัฐฯ เท่านั้น ระบุว่า

“เครื่องบินขับไล่ F-35 ของสหรัฐฯ ลงจอดฉุกเฉินที่ฐานทัพอากาศสหรัฐฯ ในตะวันออกกลาง หลังจากถูกยิง ซึ่งเชื่อว่าเป็นฝีมือของอิหร่าน”

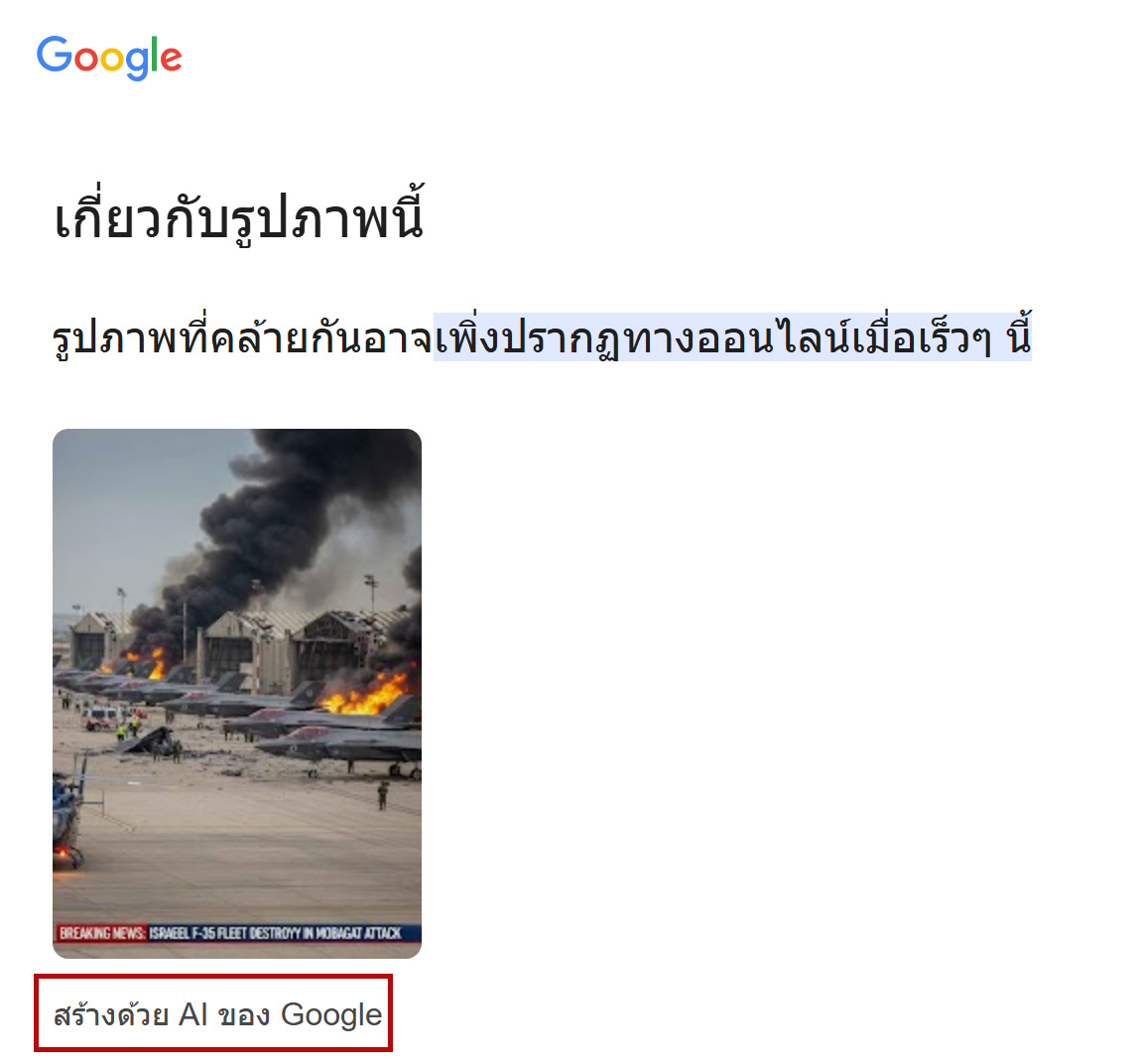

ขณะเดียวกัน พบข้อมูลในส่วน “เกี่ยวกับรูปภาพนี้” ของ Google ระบุว่าภาพดังกล่าวถูกสร้างขึ้นโดย AI ของ Google

พบข้อมูลในส่วน “เกี่ยวกับรูปภาพนี้” ของ Google ระบุว่าภาพดังกล่าวถูกสร้างขึ้นโดย AI ของ Google

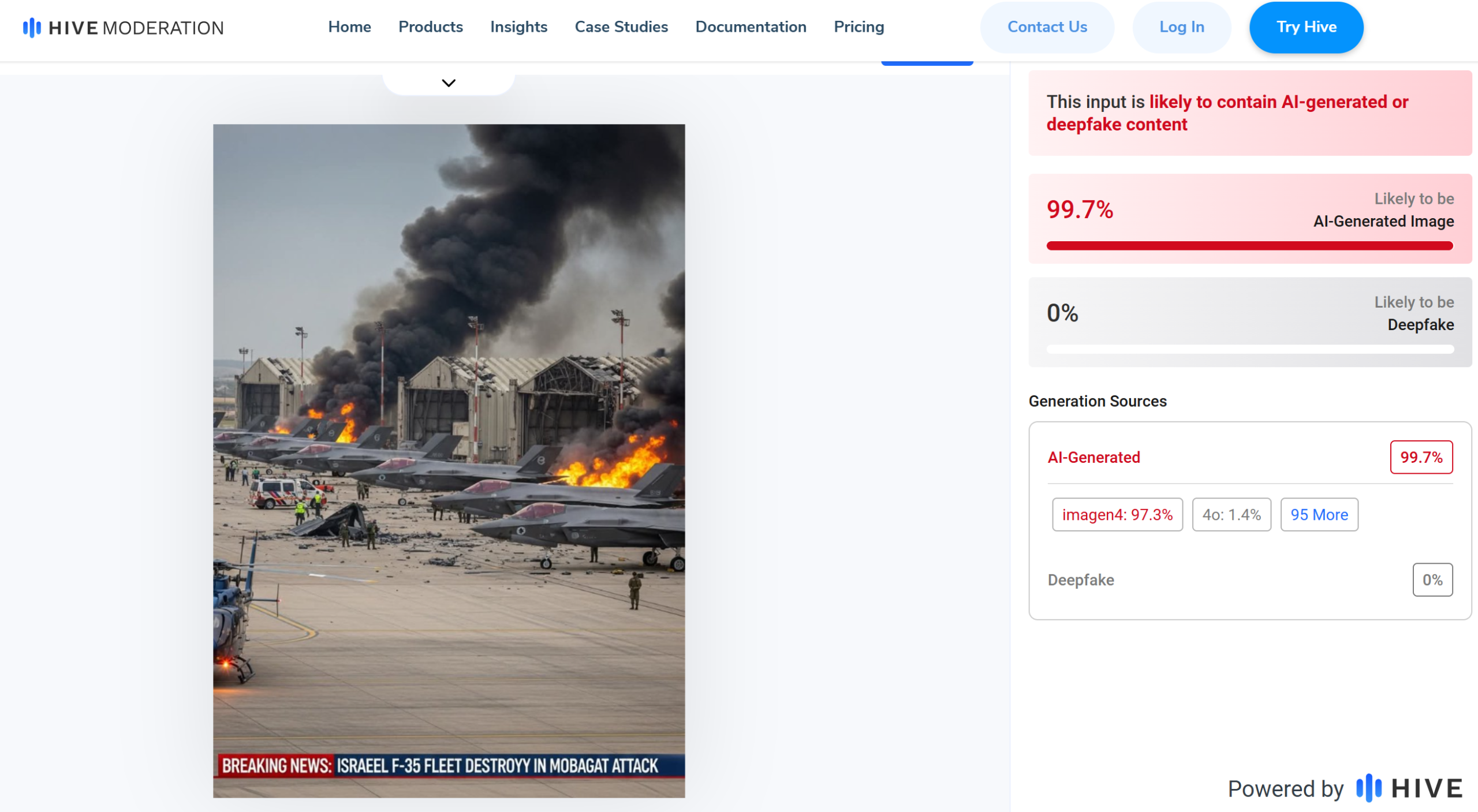

เมื่อนำภาพดังกล่าวไปตรวจสอบด้วยเครื่องมือตรวจสอบภาพ AI จากเว็บไซต์ Hive Moderation พบว่าภาพดังกล่าวมีแนวโน้มสร้างจาก AI ถึง 99.7%

เมื่อนำภาพดังกล่าวไปตรวจสอบด้วยเครื่องมือตรวจสอบภาพ AI จากเว็บไซต์ Hive Moderation พบว่าภาพดังกล่าวมีแนวโน้มสร้างจาก AI ถึง 99.7%

ข้อสังเกตความผิดปกติของรายละเอียดภาพ

ข้อสังเกตอื่น ๆ เช่น พบความปกติเรื่องตัวอักษร เมื่อสังเกตข้อความภาษาอังกฤษในภาพ จะพบว่ามีการสะกดคำผิด เช่น

- คำว่า Israel ถูกเขียนเป็น Israeel

- คำว่า destroy ถูกเขียนเป็น Destroyy

เมื่อสังเกตข้อความภาษาอังกฤษในภาพ จะพบว่ามีการสะกดคำผิด

เมื่อเปรียบเทียบภาพดังกล่าวกับภาพเครื่องบินรบ F-35 ของอิสราเอลจากแฟ้มภาพข่าวของ AFP พบว่ามีความแตกต่างชัดเจน ดังนี้

ภาพเปรียบเทียบระหว่างภาพที่สร้างจาก AI และภาพ F-35 ของอิสราเอล ถ่ายจริงจาก AFP โดย JACK GUEZ เผยแพร่เมื่อวันที่ 24 ต.ค. 64

ภาพที่สร้างจาก AI มีสัญลักษณะแฉกดาวไม่ชัดเจน และบางเครื่องก็ไม่มีสัญลักษณ์ดังกล่าว เช่น เครื่องที่ 2 นับจากขวามือ นอกจากนี้ การระบุหมายเลขที่ปีกหรือหางเครื่องก็ไม่สอดคล้องกัน บางเครื่องมีหมายเลขระบุ บางเครื่องไม่มี

และเมื่อเปรียบเทียบกับภาพถ่ายจริงจาก AFP จะพบว่า รายละเอียดบนเครื่องและตำแหน่งการระบุหมายเลขแตกต่างกันชัดเจน

ในภาพที่สร้างจาก AI พบว่ามีเศษซากเครื่องบินกระจายบนพื้น แต่ตัวเครื่องบินหลักยังคงดูสมบูรณ์ปกติ

เมื่อเปรียบเทียบภาพรวมของเครื่องบินรบกับภาพจากเว็บไซต์ U.S. Air Forces in Europe – Air Forces Africa (USAFE‑AF) ที่ถ่ายเมื่อวันที่ 16 มี.ค. 66 จะพบความแตกต่างที่ชัดเจนระหว่างภาพจริงกับภาพที่ถูกสร้างขึ้นโดย AI

หลักฐานหลายด้านบ่งชี้ว่า ภาพดังกล่าวเป็นภาพที่สร้างจาก AI ไม่ใช่ภาพถ่ายจริงจากเหตุการณ์ในจริงแต่อย่างใด

เรื่องจริงเป็นอย่างไร ?

โพสต์ที่อ้างว่าฝูงบิน F-35 ของอิสราเอลถูกทำลายบนภาคพื้นนั้น ไม่เป็นความจริง โดยภาพที่ใช้ประกอบถูกตรวจสอบแล้วว่า เป็นภาพที่สร้างขึ้นด้วย AI รวมถึง ไม่พบแหล่งที่มาจากเหตุการณ์จริง หรือ สื่อข่าวที่น่าเชื่อถือ เกี่ยวกับเหตุการณ์เครื่องบินรบ F-35 ของอิสราเอล และเมื่อค้นหาด้วยคำสำคัญ จะพบรายงานจาก CNN อ้างถึง F-35 ของสหรัฐฯ เท่านั้น

อีกทั้งยังมีข้อผิดปกติหลายจุดในภาพ เช่น การสะกดคำผิด สัญลักษณ์บนเครื่องบินไม่ถูกต้อง และรายละเอียดไม่ตรงกับภาพจริงจากแหล่งทางการ

ดังนั้นจึงสรุปได้ว่าเป็น ข่าวปลอมที่ใช้ภาพ AI มาสร้างความเข้าใจผิด ไม่ได้เกิดเหตุการณ์ดังกล่าวขึ้นจริง

กระบวนการตรวจสอบ

1.ตรวจสอบภาพด้วย Google Lens: เมื่อค้นหาแหล่งที่มาของภาพด้วยการใช้เครื่องมือตรวจสอบภาพ Google Lens พบว่าไม่ปรากฏแหล่งที่มาที่ชัดเจน หรือสอดคล้องกับรายงานของสื่อต่างประเทศแต่อย่างใด ขณะเดียวกัน พบข้อมูลในส่วน “เกี่ยวกับรูปภาพนี้” ของ Google ระบุว่าภาพดังกล่าวถูกสร้างขึ้นโดย AI ของ Google

2.ตรวจสอบภาพด้วยเครื่องมือตรวจสอบ AI: เมื่อนำภาพดังกล่าวไปตรวจสอบด้วยเครื่องมือตรวจสอบภาพ AI จากเว็บไซต์ Hive Moderation พบว่าภาพดังกล่าวมีแนวโน้มสร้างจาก AI ที่ 99.7% และสังเกตความผิดปกติของรายละเอียดภาพ

3.เปรียบเทียบภาพกับภาพจากสำนักข่าวต่างประเทศ: เมื่อเปรียบเทียบภาพดังกล่าวกับภาพเครื่องบินรบ F-35 ของอิสราเอลจากแฟ้มภาพข่าวของ AFP พบว่ามีความแตกต่างชัดเจน

ผลกระทบจากการได้รับข้อมูลลักษณะนี้

- สร้างความเข้าใจผิดในวงกว้าง ผู้รับข่าวอาจเชื่อว่าเหตุการณ์เกิดขึ้นจริง เช่น การทำลายฝูงบิน F-35 ทั้งที่ไม่เคยเกิดขึ้น ส่งผลให้การรับรู้สถานการณ์โลกคลาดเคลื่อน

- สร้างความตื่นตระหนก ข่าวเกี่ยวกับสงครามหรืออาวุธร้ายแรงสามารถกระตุ้นความกลัว ความเครียด และความกังวล โดยเฉพาะเมื่อมีภาพประกอบที่ดูสมจริง

- ถูกใช้เป็นเครื่องมือโฆษณาชวนเชื่อ (propaganda) ข้อมูลปลอมลักษณะนี้อาจถูกนำไปใช้เพื่อชี้นำความคิดเห็น สร้างภาพลักษณ์เชิงลบ หรือปลุกกระแสความเกลียดชังระหว่างประเทศ

- ลดความน่าเชื่อถือของข้อมูลจริง เมื่อข่าวปลอมแพร่กระจายมากขึ้น ผู้คนอาจเริ่มไม่เชื่อแม้กระทั่งข่าวจริง ทำให้สังคมสับสนในการแยกแยะข้อเท็จจริง

- กระตุ้นการแชร์ข้อมูลผิดซ้ำ ผู้ใช้โซเชียลมีเดียอาจแชร์ต่อโดยไม่ตรวจสอบ ทำให้ข่าวปลอมแพร่กระจายรวดเร็วและกว้างขึ้น

ข้อแนะนำเมื่อได้ข้อมูลเท็จนี้ ?

- หยุดคิดก่อนแชร์ อย่าเพิ่งเชื่อหรือแชร์ทันที โดยเฉพาะข่าวที่ใช้คำพาดหัวข่าวเร้าอารมณ์รุนแรง

- ตรวจสอบแหล่งที่มา ดูว่าเป็นโพสต์จากบัญชีที่น่าเชื่อถือหรือไม่ มีสื่อหลัก เช่น Reuters, AFP หรือหน่วยงานทางการรายงานหรือไม่

- ใช้เครื่องมือตรวจสอบภาพ ใช้ Google Lens หรือเครื่องมืออื่นเพื่อตรวจสอบว่าภาพเคยปรากฏที่ไหนมาก่อน หรือมีการระบุว่าเป็นภาพ AI หรือไม่

- สังเกตความผิดปกติของภาพ

เช่น

- ตัวอักษรสะกดผิด

- โลโก้หรือสัญลักษณ์ผิดตำแหน่ง

- รายละเอียดไม่สมจริง (เช่น ความเสียหายไม่สัมพันธ์กัน)

- เปรียบเทียบกับแหล่งข้อมูลจริง ค้นหาภาพหรือข่าวจากสื่อที่น่าเชื่อถือ หรือเว็บไซต์ทางการ เพื่อดูว่ามีเหตุการณ์เดียวกันรายงานหรือไม่