ตรวจสอบแล้ว : คลิปคนแบกช้างกลางถนน สร้างจาก AI

Thai PBS Verify พบแหล่งที่มาจาก : TikTok

จากกรณีคลิป “คนแบกช้าง” หรือ “ลุงแบกช้าง” กลางสีแยกไฟแดงที่กำลังเป็นกระแสไวรัล สร้างความสับสนและความสงสัยให้กับผู้ใช้โซเชียลเป็นจำนวนมาก จนเกิดการถกเถียงกันในโลกออนไลน์ว่าคลิปดังกล่าว เป็นเรื่องจริงหรือสร้างจากเทคโนโลยี AI กันแน่ คลิปดังกล่าวปรากฏยอดเข้าชมใน TikTok กว่า 1 ล้านครั้ง โดยระบุว่า เกิดมาพึ่งเคยเห็น “คนแบกช้าง” #เพิ่งเคยเห็น #คนแบกช้าง #ช้าง

ตัวอย่างคลิปที่สร้างจาก AI

โดยภายในคลิป มีเสียงคน 2 คนพูดว่า

(เสียงผู้ชาย) ดูนั่น ลุงแบกช้างข้ามถนน

(เสียงผู้หญิง) เกิดมาเพิ่งจะเคยเห็น

(เสียงผู้ชาย) ลุงไม่หนักเหรอ แบกไปได้ยังไง

(เสียงผู้หญิง) ถ้าเราเอาไปคลิปไปลง คนคงคิดว่าเป็น AI แน่ ๆ

นอกจากนี้ยังพบคลิปลักษณะนี้อีกเป็นจำนวนมาก ในแพลตฟอร์ต TikTok ไม่ว่าจะเป็น เฉลยแล้วว่าเขาแบกช้างไปไหน, ห้างก็ทำมาแล้ว #คนแบกช้าง,ลุงแบกช้าง #Ai

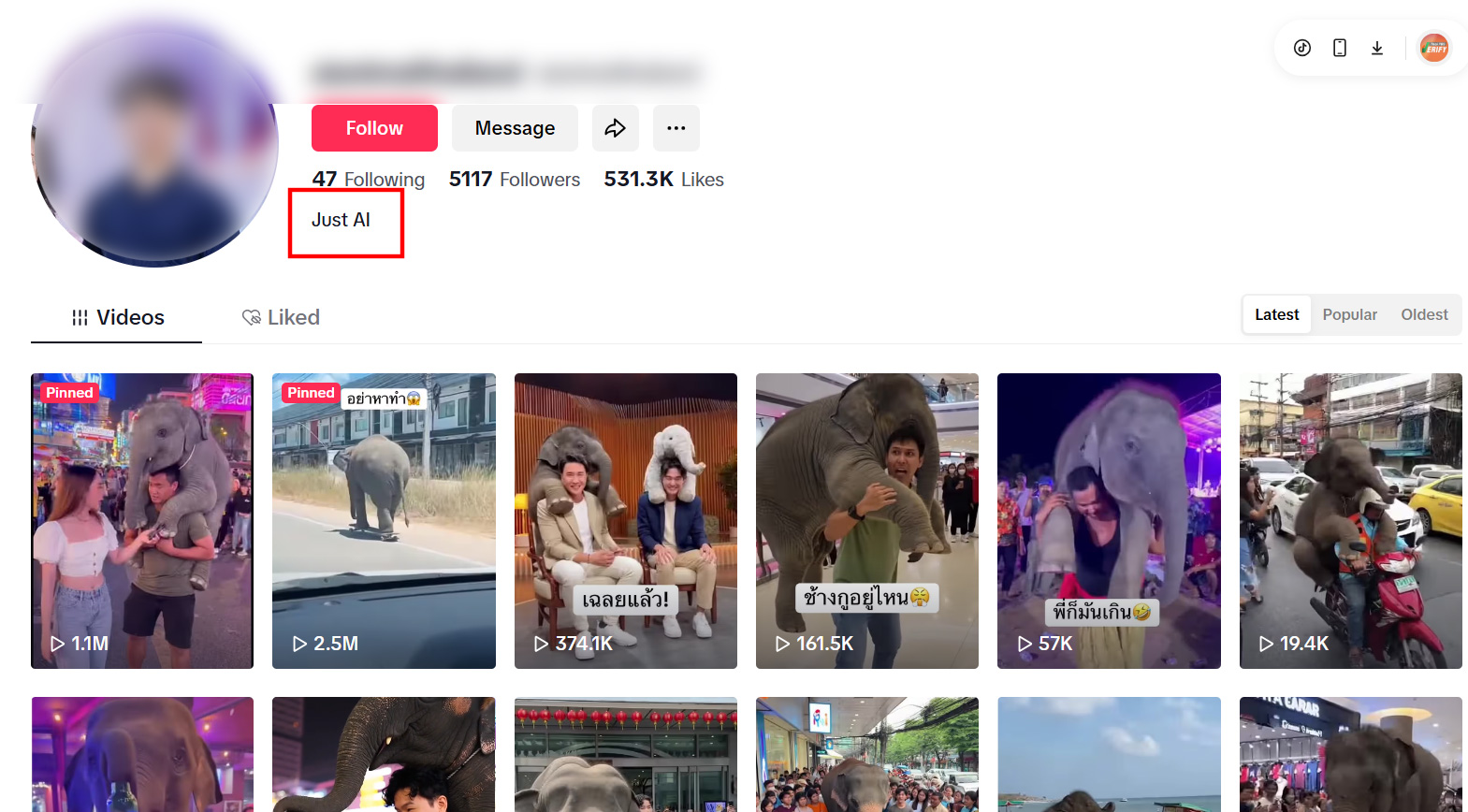

ขณะเดียวกันคลิปลุงแบกช้างในห้าง “ห้างก็ทำมาแล้ว #คนแบกช้าง” ด้านเจ้าของคลิป ได้ระบุชัดว่าเป็นคลิปสร้างจาก AI และยังผลิตเนื้อหาคลิปแบกช้างอีกหลายคลิปด้วยกัน

ผู้ใช้บัญชีรายหนึ่งใน TikTok ที่ผลิตเนื้อหาเกี่ยวกับคนแบกช้าง ระบุในช่องแนะนำตัวว่า “Just AI”

ผู้เชี่ยวชาญยืนยันคลิป “แบกช้าง” กลางถนน สร้างจาก AI

สถาพน พัฒนะคูหา CEO บริษัท Guardian AI ยืนยันกับทาง Thai PBS Verify ว่า คลิปดังกล่าวสร้างจาก AI

“แม้จะดูรวม ๆ ค่อนข้างมีความสมจริงกว่าคลิปอื่น ๆ ยกเว้นเรื่องการแบกช้างที่มีน้ำหนักค่อนข้างมาก แต่ข้อสังเกตคือตัวหนังสือภาษาไทยตามป้ายหรือลักษณะเสาไฟฟ้าที่มีความแปลก แสงและเงามีความไม่สมจริง รวมถึงการเคลื่อนไหวของรถบนถนนมีความไม่สมจริง ทำให้แยกได้ว่าเป็น AI generated”

แม้หลายคนจะตั้งข้อสังเกตว่าคลิปดังกล่าวสร้างจาก AI ที่ชื่อว่า Sora เนื่องจากมีการแสดงผลลายน้ำอยู่ในคลิป แต่ผู้เชี่ยวชาญด้าน AI ให้ความคิดเห็นว่า ลายน้ำยังไม่ถือว่าเป็นสิ่งสามารถนำมายืนยันโปรแกรมที่สร้างได้ เพราะอาจจะเป็นคลิปจากโปรแกรมอื่นแล้วนำมาใส่โลโก้ของ Sora ก็เป็นได้ หรืออาจจะสร้างจาก Sora ก็ได้เช่นกัน แต่จากการวิเคราะห์องค์ประกอบอื่น ๆ ในคลิปยืนยันว่าสร้างจาก AI แต่ข้อระวังคือ ในอนาคตเนื้อหาที่สร้างโดย AI อาจจะมีความสมจริงมากขึ้น เนื่องจากเป็นคลิปที่มีภาพส่วนจริงอยู่ด้วย แล้วสร้าง AI เฉพาะส่วนเพิ่มเติมเข้าไป

“เราต้องช่วยกันเตือน ช่วยกันหาวิธีในการตรวจสอบ อย่างคลิปคนแบกช้าง อาจไม่มีความร้ายแรงอะไร แต่ถ้าในอนาคตหากนำไปใช้ในทางที่ไม่ถูกต้อง เราต้องหาวิธีตรวจสอบให้ได้”

“ก่อนหน้านี้ เราคิดว่ารูปและคลิปมันสามารถสะท้อนความจริงได้ ตอนนี้อาจจะไม่จริงแล้ว ถ้ามันไม่สร้างความเสียหายอาจมองเป็นสีสัน แต่ถ้าเป็นเรื่องสำคัญ เรื่องที่สร้างความเสียหาย อาจต้องตรวจสอบที่มาที่ไปให้ละเอียด อย่าเพิ่งเชื่อว่าจริง” สถาพน พัฒนะคูหา กล่าว

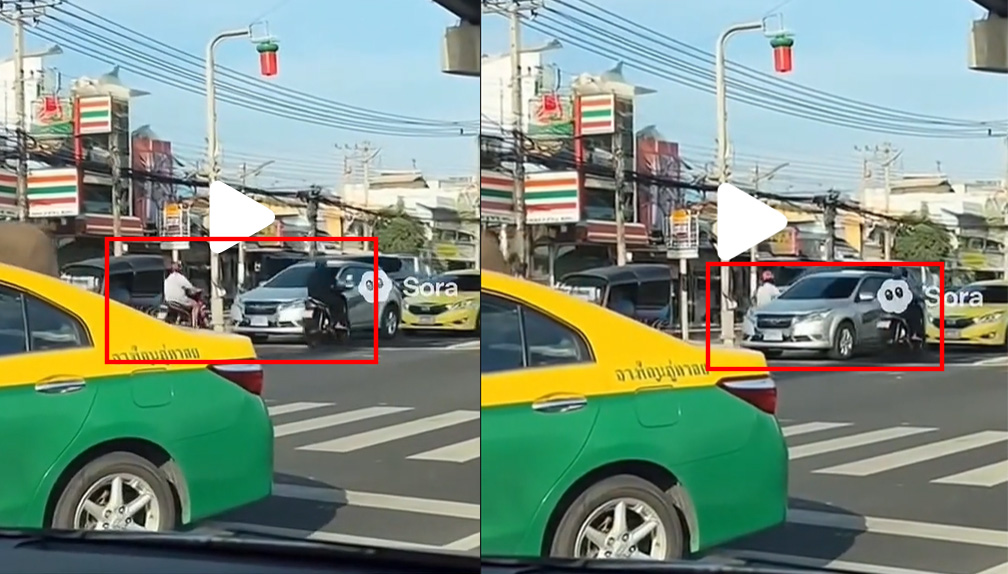

ความไม่สมเหตุสมผลในคลิปวิดีโอ

เมื่อจับสังเกตองค์ประกอบความสมจริงของบางส่วนในคลิปวิดีโอดังกล่าว พบว่า มีความผิดปกติหลายจุด เช่น ตัวอักษรภาษาไทย ป้ายทะเบียนรถแท็กซี่ หรือพฤติกรรมการขับขี่ที่ผิดปกติบนท้องถนน

ภาพบันทึกหน้าจอแสดงลักษณะการขับขี่จักรยานยนต์บนถนนที่มีความผิดปกติ โดยขับสวนทางกับรถที่จอดอยู่ ซึ่งเป็นการกระทำที่ผิดหลักจราจรและไม่สมจริง

ภาพบันทึกหน้าจอแสดงถึงความผิดปกติของตัวอักษรภาษาไทยบนรถแท็กซี่และป้ายทะเบียนรถที่มีชื่อจังหวัดที่ตีความเนื้อหาหรือชื่อจังหวัดได้

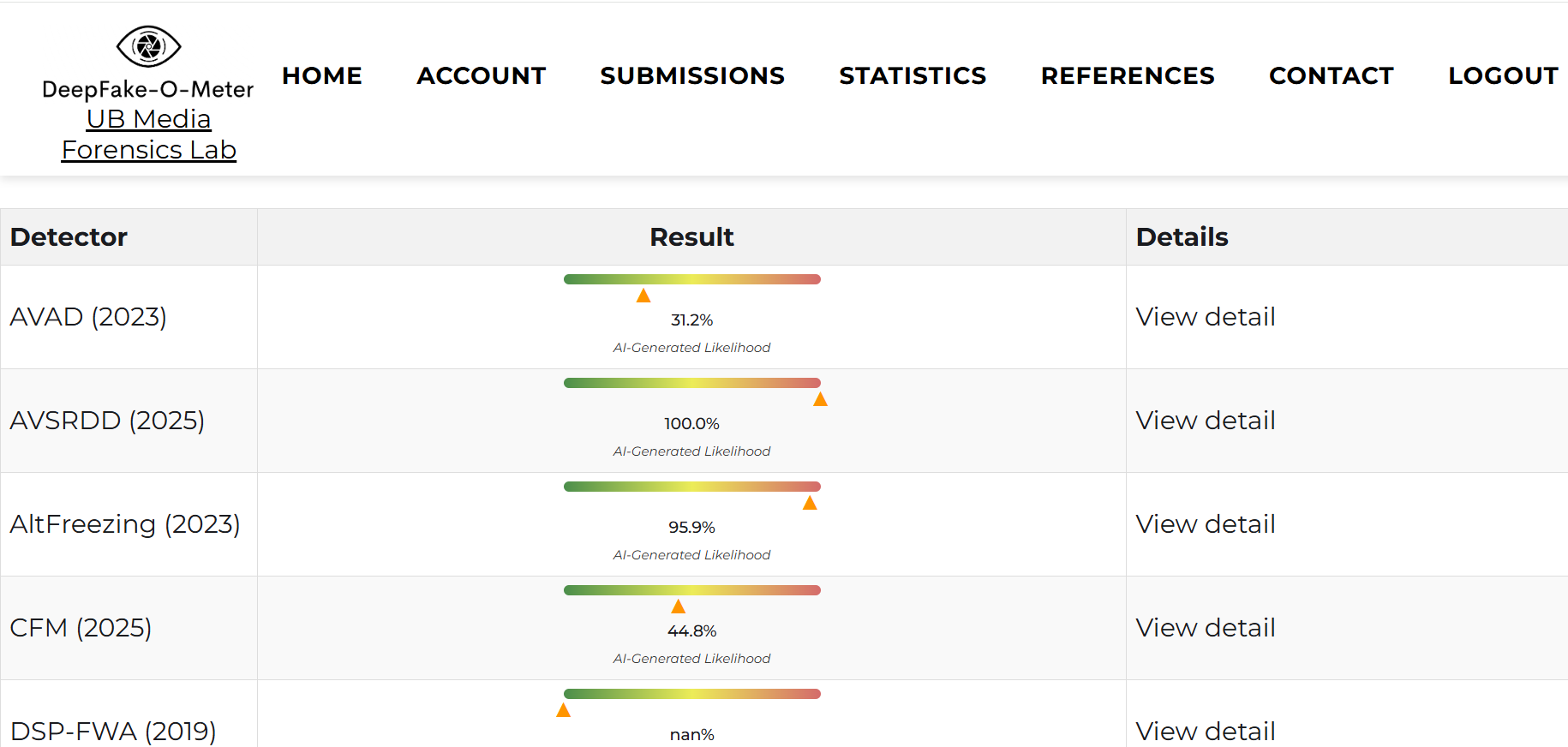

ตรวจสอบว่าสร้างจาก AI

เมื่อนำคลิปวิดีโอดังกล่าวมาตรวจสอบในเว็บไซต์ DEEPFAKE-O-METER โปรแกรมตรวจสอบ AI พบว่า คลิปดังกล่าวมีแนวโน้มสูงที่จะสร้างจาก AI

ภาพบันทึกหน้าจอแสดงผลลัพธ์การตรวจสอบคลิปวิดีโอ “คนแบกช้าง” มีแนวโน้มสร้างจาก AI ในอัตราสูง

กระบวนการตรวจสอบ

ใช้เครื่องมือตรวจสอบ AI: นำคลิปวิดีโอมาตรวจสอบผ่านเว็บไซต์ DEEPFAKE-O-METER ซึ่งเป็นโปรแกรมตรวจจับสื่อที่สร้างจาก AI โดยผลการตรวจสอบระบุว่า คลิป “คนแบกช้าง” มีแนวโน้มสูงที่จะสร้างจาก AI

สอบถามผู้เชี่ยวชาญด้าน AI: ยืนยันจากผู้เชี่ยวชาญด้านเทคโนโลยีปัญญาประดิษฐ์ ว่าคลิปดังกล่าวไม่ได้มาจากเหตุการณ์จริง รวมถึงเมื่อวิเคราะห์แสงและเงาแล้ว มีความไม่สมจริงประกอบกับการเคลื่อนไหวของรถบนถนนที่ไม่สมจริง ทำให้แยกได้ว่าเป็นเนื้อหาที่สร้างจาก AI สังเกตความผิดปกติขององค์ประกอบภาพหรือคลิป : ตรวจสอบลักษณะของตัวอักษร แสง เงา การเคลื่อนไหวของคนและรถ รวมถึงองค์ประกอบโดยรอบพบว่าขัดต่อความสมจริง

ผลกระทบจากการรับข้อมูลเท็จ

1.สร้างความเข้าใจผิดในสังคมและบิดเบือนข้อเท็จจริง

ผู้ชมอาจเชื่อว่าคลิปเป็นเหตุการณ์จริง นำไปสู่การแชร์ต่อโดยไม่ได้ตรวจสอบ

2.ทำให้เกิดความชินชาและลดทักษะการรู้เท่าทันสื่อ/ภาพ

การรับข้อมูลเท็จบ่อยครั้งโดยไม่ตรวจสอบ อาจทำให้ผู้ใช้ไม่สนใจตรวจความจริงนำไปสู่ช่องโหว่ในการนำไปสร้างเนื้อหาในลักษณะเสียหายได้หรือถูกนำไปใช้ในทางอาชญากรรมออนไลน์ได้

ข้อแนะนำเมื่อได้ข้อมูลเท็จนี้ ?

1.ตรวจสอบที่มาของคลิปก่อนแชร์: ก่อนกดแชร์คลิป ควรตรวจสอบว่าเนื้อหามีแหล่งที่มาอย่างชัดเจนหรือไม่ เช่น ตรวจสอบชื่อบัญชีผู้โพสต์ วันเวลาเผยแพร่ และข้อความประกอบคลิปว่าระบุเนื้อหาว่าสร้างจาก AI หรือไม่ หรือใช้หากใช้ข้อความเร้าอารมณ์เกิน ให้ระมัดระวังว่าอาจเป็นเนื้อหาเท็จ

2.สังเกตความผิดปกติของภาพ เช่น ตัวอักษร แสงเงา หรือการเคลื่อนไหว คลิปหรือภาพที่สร้างจาก AI มักมีรายละเอียดบางส่วนที่ไม่สมจริง เช่น ตัวอักษรภาษาไทยที่บิดเบี้ยวหรืออ่านไม่ออก ลักษณะเงาที่ไม่สัมพันธ์กับทิศทางของแสง การเคลื่อนไหวของคนหรือวัตถุที่ผิดธรรมชาติ รวมถึงพื้นผิววัตถุที่ดูเบลอหรือไม่สอดคล้องกัน การสังเกตสิ่งเหล่านี้ช่วยให้แยกแยะคลิปจริงกับคลิปจำลองได้ดีขึ้น

3.ใช้เครื่องมือตรวจสอบสื่อ AI เช่น Deepfake-O-Meter หรือ Hive moderation: การใช้เครื่องมือเหล่านี้ประเมินเบื้องต้น ช่วยเพิ่มความมั่นใจก่อนตัดสินใจเชื่อหรือแชร์เนื้อหาใด ๆ